Data afhandelen en berekeningen maken is alles wat een computer doet. Je zal nooit een tekort aan data hebben bij normaal gebruik. Dan heb je altijd wel 1 of meerdere programma's open die wat aan het doen zijn.

Maar goed, ik denk dat we langs elkaar aan het praten zijn. We hebben allemaal niet superveel verstand van computerhardware of van low-level programmeren. Misschien bedoelen we wel hetzelfde, maar zeggen we het te onduidelijk

Ik probeer het wat duidelijker te maken:

Het maximale geheugen wat een 32-bits processor kan adresseren is ongeveer 4 GB. Heb je zoveel programma's en gegevens dat dat niet genoeg is, dan is meer geheugen en een 64-bits processor een betere keuze.

Zie het als de verhoudingen tussen FAT32 en NTFS/Ext3. FAT32 had ook beperkingen die met de nieuwere systemen opgelost werden.

Dat is deel 1.

Deel 2 is hoe de verschillende processors hun berekeningen doen. Dit is dus onafhankelijk van de hoeveelheid geheugen die ze kunnen adresseren.

Een 64-bits processor rekent met veel grotere getallen, extra registers en nog wat hardware waar ik de werking niet van snap. Hierdoor is die stukken sneller dan een 32-bits processor, bij heel veel berekeningen.

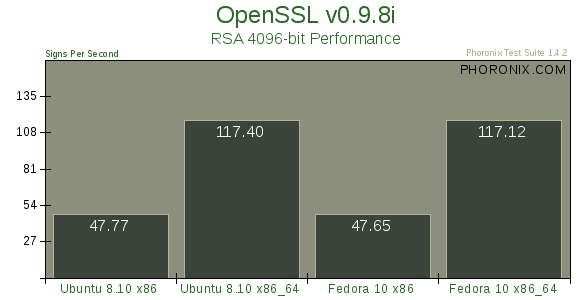

Hoe vertaalt dit zich in de praktijk? Als je veel multitaskt, een webserver draait, zelf programma's compileert, audio en video gebruikt, etc. dan is een 64-bits processor sneller, omdat hij de berekeningen die hiervoor nodig zijn sneller doet. In de benchmarks die ik eerder linkte zag je winsten tot 80% in sommige gevallen. Soms was er een klein verlies (niet geoptimaliseerde software?), maar gemiddeld is het iets van 20% winst. Die benchmark was gedaan op een systeem met minder dan 4 GB geheugen.

Die resultaten van de benchmark zijn ook van andere onderdelen afhankelijk, bijvoorbeeld van data die van de harde schijf moet komen of van het netwerk.

Voorbeeldje:

Dit wordt begrensd door de harde schijf waarschijnlijk.

Maar bij encryptie ziet het er ineens heel anders uit:

Die plaatjes zijn gemaakt op een systeem met maar 2 GB geheugen.